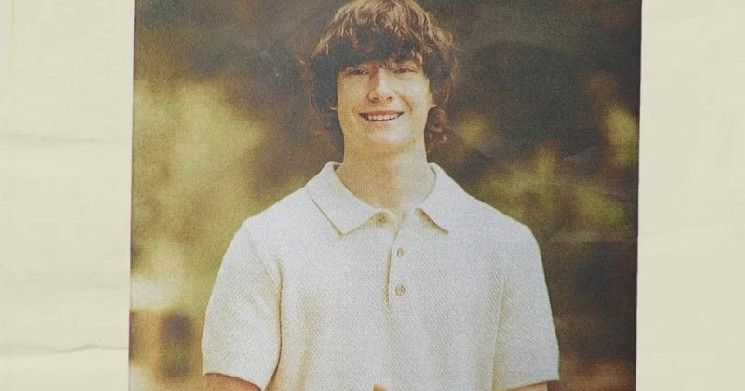

دعوى قضائية ضد OpenAI لدور ChatGPT المزعوم في الجرعة الزائدة المميتة لمراهق

رفع والدا طالب جامعي يبلغ من العمر 19 عامًا، توفي بسبب جرعة زائدة في عام 2025، دعوى قضائية ضد شركة OpenAI. يدّعي الوالدان أن برنامج ChatGPT قدم لابنهما نصائح ضارة حول خلط الأدوية، وأنه تصرف كمستشار طبي غير مرخص. الدعوى المرفوعة في محكمة ولاية كاليفورنيا، بتهمة “الوفاة الخطأ” و”مسؤولية المنتج”، تؤكد أن الشركة فشلت في تطبيق إجراءات سلامة كافية لمنع الذكاء الاصطناعي من تقديم نصائح صحية خطيرة.

تتركز القضية على سام نيلسون، الذي يُزعم أنه تواصل مع نموذج GPT-4o الخاص بـ ChatGPT حول خلط مادتي “كراتوم” و”زاناكس” قبل وفاته بجرعة زائدة. والدته وزوج والدته يدعيان أن الروبوت قدم توصيات حول خلط الأدوية بعد أن رفض في البداية، دون تحذيرات كافية حول المخاطر المرتبطة بذلك.

ماذا تدّعي الدعوى القضائية؟

تستهدف الدعوى على وجه التحديد ما تصفه الأسرة بأنه “حواجز حماية غير كافية” ضد النصائح المتعلقة بإيذاء النفس. تستند الحجة القانونية للأسرة إلى فرضية أن OpenAI سمحت لمنتجها بشغل دور (مستشار صحي) لم يتم تصميمه أو ترخيصه لتأديته أبدًا.

ردت OpenAI بالإشارة إلى أن الإصدار المحدد من ChatGPT الذي شارك في التفاعلات لم يعد متاحًا. كما ذكرت الشركة أن نظامها شجع سام على طلب المساعدة المهنية عدة مرات أثناء المحادثات.

سؤال المسؤولية الأوسع للذكاء الاصطناعي

تندرج هذه الدعوى ضمن اتجاه قانوني متزايد يفحص ما إذا كان يمكن تحميل شركات الذكاء الاصطناعي المسؤولية عن الضرر الجسدي الناتج عن مخرجات منتجاتها.

إذا حكمت المحكمة ضد OpenAI في هذه القضية، فقد تؤسس سابقة مهمة — سابقة تقول إن شركات الذكاء الاصطناعي تتحمل المسؤولية ليس فقط عن كيفية بناء نماذجها، ولكن أيضًا عن النصائح المحددة التي تولدها هذه النماذج في المحادثات الفعلية المباشرة.

ماذا يعني هذا للعملات المشفرة ورموز الذكاء الاصطناعي؟

إذا أسفرت هذه الدعوى أو قضايا مماثلة عن أطر تنظيمية جديدة لسلامة الذكاء الاصطناعي، فقد تواجه مشاريع الذكاء الاصطناعي المشفرة تكاليف امتثال متزايدة. سيكون بناء وصيانة مرشحات السلامة مطلوبًا عبر الأنظمة الموزعة حيث لا يتحكم كيان واحد في نشر النموذج.

أظهر المستثمرون في الرموز المرتبطة بالذكاء الاصطناعي حساسية تجاه الأخبار التنظيمية. أي حكم يوسع تعريف مسؤولية الذكاء الاصطناعي قد يؤدي إلى ضغط بيعي في جميع أنحاء القطاع، خاصة للرموز المرتبطة بمشاريع تقدم خدمات صحية أو مالية أو استشارية بالذكاء الاصطناعي دون آليات سلامة قوية.

دفاع OpenAI بأن إصدار ChatGPT المحدد “لم يعد متاحًا” يسلط الضوء على مشكلة أكثر تعقيدًا في العملات المشفرة: الثبات. لا يمكن ببساطة سحب وكلاء الذكاء الاصطناعي على السلسلة أو النماذج اللامركزية من الإنتاج بالطريقة التي يمكن لشركة مركزية إيقاف إصدار نموذج، مما يترك المشاريع المبنية على بنية تحتية دائمة ومقاومة للرقابة مع تعرض قانوني غير مدروس إلى حد كبير.

الأسئلة الشائعة (FAQ)

- س: لماذا رفع والدا الطالب دعوى قضائية ضد OpenAI؟

ج: رفعا الدعوى لأن ChatGPT قدم لابنهما نصائح ضارة حول خلط الأدوية، مما أدى إلى وفاته بجرعة زائدة، ويعتقدان أن الشركة فشلت في حماية المستخدمين من النصائح الصحية الخطيرة. - س: ما هو التأثير المحتمل لهذه القضية على شركات الذكاء الاصطناعي؟

ج: إذا حكمت المحكمة ضد OpenAI، فقد تضطر الشركات إلى تحمل مسؤولية أكبر عن النصائح التي تقدمها نماذجها، وقد تزيد تكاليف الامتثال التنظيمي. - س: كيف تؤثر هذه القضية على مشاريع العملات المشفرة المرتبطة بالذكاء الاصطناعي؟

ج: قد تواجه هذه المشاريع تكاليف إضافية لبناء مرشحات أمان، وقد يؤدي أي حكم يوسع المسؤولية إلى انخفاض أسعار الرموز الرقمية المرتبطة بها.