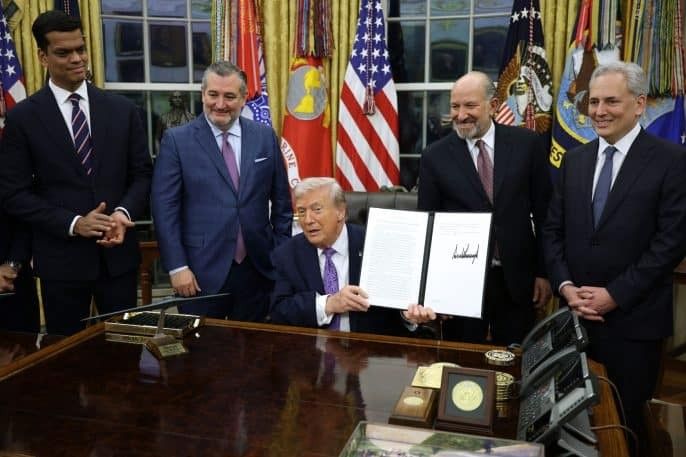

إدارة ترامب تعد أمرًا أمنيًا للذكاء الاصطناعي للوكالات الأمريكية

تستعد إدارة الرئيس ترامب لإصدار أمر تنفيذي يلزم الوكالات الحكومية الأمريكية بالتعاون مع شركات الذكاء الاصطناعي لتعزيز أمن الشبكات ضد الهجمات الإلكترونية المدعومة بالذكاء الاصطناعي.

أين يقع هذا الأمر في خطة الذكاء الاصطناعي الأوسع؟

سيأتي أمر الأمن السيبراني هذا ليكمل مجموعة متزايدة من الأوامر التنفيذية المتعلقة بالذكاء الاصطناعي الصادرة عن البيت الأبيض. ففي 23 يناير 2025، وقع الرئيس الأمر التنفيذي رقم 14179، الذي ركز بشكل كامل على إزالة العقبات أمام ريادة أمريكا في مجال الذكاء الاصطناعي.

ثم في 11 ديسمبر 2025، صدر أمر تنفيذي ثان بعنوان “ضمان إطار سياسة وطنية للذكاء الاصطناعي” لدفع الاستراتيجية إلى الأمام. وقد وجه هذا الأمر بتشكيل فريق عمل للتقاضي في مجال الذكاء الاصطناعي، وكلف وزير التجارة بمراجعة قوانين الذكاء الاصطناعي على مستوى الولايات بحلول 11 مارس 2026.

كما منح أمر ديسمبر كلًا من ديفيد ساكس، مسؤول الذكاء الاصطناعي والعملات الرقمية في الإدارة، ومايكل كراتسيوس مهمة محددة: صياغة إطار فيدرالي للذكاء الاصطناعي يهدف إلى تجاوز تشابك القوانين التنظيمية على مستوى الولايات. وتم منح رئيس لجنة الاتصالات الفيدرالية (FCC) مهلة 90 يومًا لبدء الإجراءات المتعلقة بمعايير الإبلاغ الفيدرالية لنماذج الذكاء الاصطناعي.

ماذا يعني هذا للمستثمرين؟

الخطر الذي يجب مراقبته هو توسع نطاق الأمر. فالأمر المصمم لتحسين الدفاع السيبراني الفيدرالي قد يتطور إلى متطلبات أوسع تؤثر على كيفية عمل شركات الذكاء الاصطناعي، وما يُطلب منها الكشف عنه بشأن قدرات نماذجها، أو نوع اختبارات الأمان (Red Teaming) التي يجب إجراؤها قبل إطلاق النماذج.

الأسئلة الشائعة:

س: ما هو الهدف الرئيسي من هذا الأمر التنفيذي الجديد؟

ج: الهدف هو جعل الوكالات الحكومية الأمريكية تتعاون مع شركات الذكاء الاصطناعي لتحسين أمن الشبكات وحمايتها من الهجمات الإلكترونية التي تستخدم تقنيات الذكاء الاصطناعي.

س: كيف يرتبط هذا الأمر بأوامر الذكاء الاصطناعي السابقة؟

ج: هذا الأمر يضاف إلى أوامر سابقة مثل الأمر التنفيذي رقم 14179 الذي ركز على دعم الريادة الأمريكية في الذكاء الاصطناعي، وأمر ديسمبر 2025 الذي دعا لوضع إطار فيدرالي لتوحيد قوانين الذكاء الاصطناعي على مستوى البلاد.

س: ما هو الخطر المحتمل على شركات الذكاء الاصطناعي والمستثمرين؟

ج: الخطر هو أن يتوسع نطاق الأمر ليشمل متطلبات إضافية مثل الكشف عن قدرات نماذج الذكاء الاصطناعي أو إجراء اختبارات أمان إجبارية قبل إطلاقها، مما قد يزيد الأعباء التنظيمية على الشركات.